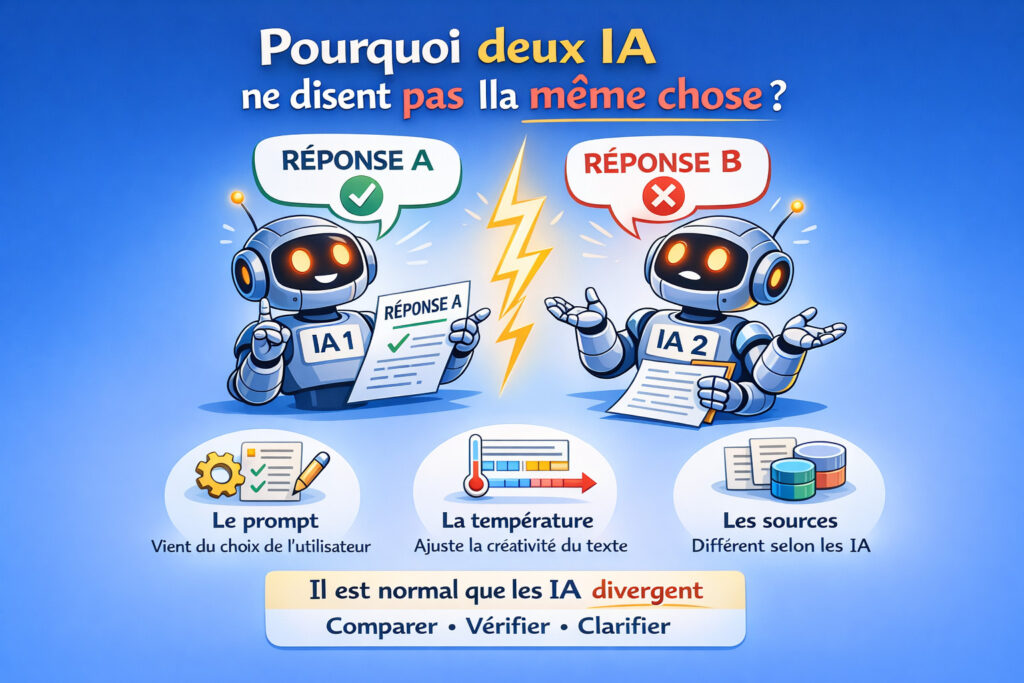

C’est une réaction très fréquente : vous posez “la même question” à deux IA, ou même deux fois à la même, et vous n’obtenez pas exactement la même réponse. Parfois la différence est minime. Parfois elle est énorme : angle différent, niveau de prudence différent, sources différentes, voire conclusion différente.

Le réflexe naïf consiste à croire qu’une seule réponse devrait être “la bonne” et que toute variation prouve qu’une IA se contredit. Ce n’est pas si simple.

Une IA ne fonctionne pas comme une base de données figée qui restituerait une fiche identique à chaque requête. Elle produit une réponse à partir d’un ensemble de paramètres, de probabilités, de contexte, de formulation et parfois de sources externes. Dès qu’un de ces éléments change, la sortie peut bouger.

Le vrai point à comprendre est donc celui-ci : deux réponses différentes ne signifient pas forcément qu’une IA “ment” ou “ne sait pas”. Cela peut simplement vouloir dire qu’elle interprète différemment la demande, qu’elle priorise d’autres éléments, ou qu’elle travaille avec un cadre différent.

La fausse idée : “même question = même réponse”

En théorie, on imagine une logique simple : si la question est la même, la réponse devrait l’être aussi.

En pratique, cette attente repose sur une mauvaise image du fonctionnement des modèles génératifs. Une IA ne va pas chercher une vérité unique stockée dans un tiroir. Elle génère une réponse plausible à partir :

- du texte que vous lui donnez ;

- de la manière dont il est formulé ;

- du contexte déjà présent dans la conversation ;

- du modèle utilisé ;

- des réglages de génération ;

- des éventuelles sources ou outils mobilisés ;

- des garde-fous appliqués en arrière-plan.

Autrement dit, deux requêtes apparemment proches peuvent en réalité ne pas être traitées dans le même cadre.

Et même quand vous pensez poser “exactement” la même question, ce n’est pas toujours vrai : un mot, un ton, un détail implicite, ou simplement le contexte précédent peuvent déjà orienter la réponse autrement.

Le prompt : le point de départ, donc le premier facteur de divergence

Le facteur le plus évident, c’est le prompt, c’est-à-dire votre demande.

On sous-estime souvent à quel point de petites variations changent le résultat. Pourtant, une IA ne traite pas seulement le “sujet”. Elle traite la manière dont vous le présentez.

Par exemple, ces trois formulations ne déclenchent pas la même logique :

- “Explique-moi ce sujet.”

- “Donne-moi une réponse simple pour débutant.”

- “Analyse ce sujet comme un expert et signale les limites.”

Le thème est identique. Mais l’objectif, le niveau attendu et le format implicite changent complètement.

Même un détail qui paraît anodin peut orienter la sortie :

- un mot plus émotionnel ;

- une demande plus tranchée ;

- un angle plus technique ;

- un ton plus polémique ;

- une question fermée au lieu d’une question ouverte.

Une IA lit ces signaux et adapte sa réponse. Ce n’est pas secondaire. C’est le cœur du système.

La formulation change l’interprétation, même quand le sujet reste le même

Il faut aller un cran plus loin : deux formulations proches ne modifient pas seulement le style de la réponse. Elles peuvent changer ce que l’IA comprend de votre demande.

Exemple simple :

- “Est-ce qu’un VPN est utile ?”

- “Est-ce qu’un VPN protège vraiment ?”

- “Est-ce qu’un VPN rend anonyme ?”

Ces trois questions parlent du même univers. Pourtant, elles n’appellent pas la même réponse sérieuse :

- la première ouvre sur les usages ;

- la deuxième sur la sécurité réelle ;

- la troisième sur une promesse souvent trompeuse.

Le danger, c’est de croire que l’IA “se contredit” alors qu’en réalité elle répond à trois problèmes différents.

C’est aussi pour cela qu’un utilisateur peu précis obtient souvent des réponses variables : l’IA comble les zones floues. Et selon la manière dont elle interprète le flou, le résultat peut bouger.

Le rôle du contexte caché : la conversation pèse plus qu’on ne le croit

Deux réponses peuvent diverger simplement parce qu’elles ne sont pas produites dans le même contexte conversationnel.

C’est un point que beaucoup oublient. Une IA ne répond pas toujours uniquement à votre dernier message. Elle peut aussi prendre en compte :

- ce que vous avez demandé juste avant ;

- le niveau de détail déjà utilisé ;

- le ton installé dans l’échange ;

- les consignes accumulées dans la conversation ;

- les corrections ou préférences déjà exprimées.

Cela veut dire qu’une même question posée :

- dans un nouveau chat ;

- au milieu d’une longue discussion ;

- après une demande technique ;

- après un échange très simple ;

peut produire une réponse différente.

La question affichée semble identique. Le contexte réel, lui, ne l’est pas.

La température : pourquoi une IA peut varier même à question identique

La “température” est souvent citée, parfois de façon confuse. Il faut la remettre à sa place.

En simplifiant sans trahir : la température influence la variabilité du texte généré. Plus elle est élevée, plus le modèle a tendance à explorer des formulations ou des choix moins prévisibles. Plus elle est basse, plus il tend vers des réponses plus stables, plus probables, plus resserrées.

Donc oui, à prompt identique, une température plus élevée peut produire :

- des formulations plus variées ;

- des angles un peu différents ;

- plus de créativité ;

- parfois plus de prise de risque ;

- et parfois aussi plus d’erreurs.

À l’inverse, une température plus basse favorise souvent :

- plus de cohérence ;

- plus de répétabilité ;

- moins de dispersion ;

- mais aussi parfois des réponses plus plates ou plus rigides.

Il faut toutefois rester précis : la température n’est pas un bouton magique qui explique tout. C’est un levier parmi d’autres. Et dans beaucoup d’interfaces grand public, vous n’y avez même pas accès directement.

Donc quand deux réponses diffèrent, il est possible que la température joue. Mais il est intellectuellement paresseux d’en faire l’explication unique.

La température n’explique pas tout : il y a aussi l’échantillonnage et les choix de génération

Même quand on parle de “température”, on résume souvent trop.

La génération d’un texte dépend aussi d’autres choix internes ou techniques :

- la manière de sélectionner le prochain mot ou groupe de mots ;

- les limites imposées à certaines formulations ;

- les filtres de sécurité ;

- la longueur cible ;

- la priorité donnée à la prudence, à la concision ou à l’utilité.

En clair : deux IA peuvent être proches sur le fond, mais différentes dans leur manière de générer. Cela suffit à produire des écarts de ton, de structure, voire de niveau de confiance.

C’est pour cela qu’il faut éviter la phrase simpliste : “C’est juste la température.” Souvent, c’est plus large : c’est tout le mode de génération qui n’est pas identique.

Les sources : une réponse dépend aussi de ce que l’IA mobilise

Deux IA peuvent diverger parce qu’elles ne s’appuient pas sur les mêmes matériaux.

Selon les cas, une IA peut répondre à partir :

- de son entraînement général ;

- de documents fournis dans le contexte ;

- d’une recherche web ou d’une base externe ;

- d’un système de récupération de documents ;

- d’un corpus interne spécifique à l’outil.

Et là, les écarts deviennent logiques.

Si l’une s’appuie sur des sources récentes et l’autre sur une connaissance plus ancienne, leurs réponses peuvent différer.

Si l’une privilégie une documentation officielle et l’autre un résumé secondaire, l’angle peut changer.

Si l’une mobilise un corpus marketing et l’autre un corpus plus technique, la sortie ne dira pas la même chose.

Ce n’est pas seulement une question de “vérité”. C’est une question de matière première.

La date : un même sujet peut avoir plusieurs “bonnes” réponses selon le moment

C’est un facteur massivement sous-estimé.

Sur beaucoup de sujets, la réponse dépend du moment où la question est posée :

- une loi change ;

- un produit évolue ;

- un tarif est mis à jour ;

- une faille est corrigée ;

- une politique de confidentialité est modifiée ;

- un outil ajoute ou retire une fonction ;

- une entreprise change de position.

Dans ces cas-là, deux réponses différentes ne sont pas forcément incompatibles. Elles peuvent simplement refléter deux états du monde différents.

C’est particulièrement vrai pour :

- l’actualité ;

- la réglementation ;

- les logiciels ;

- les offres commerciales ;

- la cybersécurité ;

- les performances de services ;

- les décisions politiques ou d’entreprise.

Un modèle, une IA, ou une réponse qui n’intègre pas la même fraîcheur d’information peut donc diverger sans que cela relève d’une “contradiction” au sens strict.

Deux IA n’ont pas forcément le même niveau de mise à jour

Même quand elles semblent traiter le même sujet, deux IA ne sont pas nécessairement à jour au même niveau.

L’une peut :

- disposer d’un accès à des sources externes ;

- travailler avec un corpus plus récent ;

- intégrer des documents spécifiques ;

- avoir été ajustée pour certains domaines.

L’autre peut :

- répondre sans accès externe ;

- s’appuyer sur un entraînement plus daté ;

- être plus prudente ;

- ou au contraire plus affirmée malgré des données moins fraîches.

Le résultat, c’est que vous pouvez obtenir deux réponses incompatibles alors que le sujet, lui, a simplement évolué entre-temps — ou n’est pas traité avec le même degré d’actualité.

Le modèle lui-même : deux IA ne sont pas le même cerveau

C’est évident, mais souvent oublié : “deux IA” ne désigne pas un seul et même système avec deux skins différents.

Deux modèles peuvent diverger parce qu’ils n’ont pas :

- la même architecture ;

- le même entraînement ;

- les mêmes priorités ;

- le même calibrage de prudence ;

- la même tolérance à l’incertitude ;

- la même capacité à nuancer ;

- la même manière de gérer les zones floues.

L’un peut privilégier une réponse directe.

L’autre peut préférer nuancer.

L’un peut combler les trous plus agressivement.

L’autre peut mieux signaler ses limites.

L’un peut “oser” davantage.

L’autre peut paraître plus sec, mais plus prudent.

Donc, même avec un prompt très proche, deux IA peuvent donner deux réponses différentes simplement parce qu’elles n’ont pas la même personnalité technique.

Les garde-fous et les politiques de sécurité influencent aussi le résultat

Deux réponses peuvent diverger non pas à cause du fond du sujet, mais à cause de la manière dont le système décide de le traiter.

Certaines IA sont plus restrictives sur :

- les conseils sensibles ;

- les sujets juridiques ;

- la santé ;

- la cybersécurité ;

- les contenus controversés ;

- les affirmations trop catégoriques.

Cela peut produire des écarts très visibles :

- l’une répond franchement ;

- l’autre se montre prudente ;

- l’une refuse un angle ;

- l’autre accepte mais reformule ;

- l’une détaille ;

- l’autre se limite à un cadre général.

Vu de l’utilisateur, cela ressemble parfois à une incohérence. En réalité, c’est souvent un effet de politique de réponse, pas seulement un désaccord de fond.

Même la longueur demandée peut changer la réponse

Un point plus subtil : une réponse courte et une réponse longue ne disent pas toujours exactement la même chose, même sur le même sujet.

Pourquoi ? Parce qu’une réponse courte :

- simplifie davantage ;

- coupe les exceptions ;

- va droit au schéma dominant ;

- élimine des nuances.

Une réponse plus longue peut :

- introduire des cas limites ;

- distinguer plusieurs contextes ;

- reconnaître des incertitudes ;

- corriger une simplification implicite.

Résultat : si vous demandez un “résumé rapide”, vous pouvez obtenir une réponse plus tranchée. Si vous demandez une “analyse détaillée”, vous pouvez obtenir une réponse plus nuancée.

Ce n’est pas toujours une contradiction. C’est parfois la différence entre un raccourci utile et une réponse plus complète.

Pourquoi la même IA peut se répondre différemment à elle-même

C’est souvent ce qui surprend le plus : vous reposez la même question, à la même IA, et la réponse change.

Cela peut venir de plusieurs choses en même temps :

- une part de variabilité dans la génération ;

- un contexte conversationnel légèrement modifié ;

- une interprétation différente d’un mot flou ;

- une priorisation différente entre concision et nuance ;

- une sélection différente dans les exemples ou les arguments.

Tant que la question n’appelle pas une restitution purement mécanique, il existe une marge de variation normale.

Cela ne veut pas dire que tout se vaut. Cela veut dire que la réponse n’est pas une “sortie figée”, surtout si le sujet admet plusieurs angles raisonnables.

Quand la différence devient un vrai signal d’alerte

Il ne faut pas non plus tout excuser.

Si deux réponses diffèrent seulement par :

- la structure ;

- le ton ;

- les exemples ;

- le niveau de détail ;

ce n’est pas forcément problématique.

En revanche, il faut lever un drapeau quand deux réponses donnent :

- des faits incompatibles ;

- des dates contradictoires ;

- des chiffres différents sans justification ;

- des règles opposées ;

- des conclusions tranchées sans expliquer le changement de cadre.

Là, il ne faut pas choisir au hasard celle qui vous plaît le plus. Il faut revenir à la base :

- quelle était exactement la question ;

- quel contexte était implicite ;

- quelles sources étaient utilisées ;

- quelle réponse est la mieux justifiée ;

- qu’est-ce qui peut être vérifié indépendamment.

Une divergence forte n’est pas forcément une preuve d’incompétence. Mais c’est toujours un signal qu’il faut arrêter de consommer la réponse passivement.

Le bon réflexe : comparer les cadres, pas seulement les phrases

Quand deux réponses diffèrent, la mauvaise méthode consiste à les lire comme deux verdicts en compétition.

La bonne méthode consiste à comparer leur cadre :

- répondent-elles exactement à la même question ?

- utilisent-elles le même niveau de détail ?

- parlent-elles du même pays, de la même période, du même outil, de la même version ?

- l’une simplifie-t-elle plus que l’autre ?

- l’une cite-t-elle des limites que l’autre omet ?

- l’une repose-t-elle sur une source plus récente ou plus sérieuse ?

Très souvent, la divergence devient plus compréhensible dès qu’on compare le cadre de réponse au lieu de comparer seulement la phrase finale.

Ce qu’il faut retenir

Si deux IA, ou deux réponses, ne disent pas exactement la même chose sur le même sujet, ce n’est pas forcément parce que l’une est “fausse” et l’autre “vraie”. C’est souvent parce qu’elles ne travaillent pas avec le même prompt, le même contexte, la même variabilité de génération, les mêmes sources, la même date ou la même interprétation de la demande.

Le prompt oriente.

La formulation change le sens.

La température peut faire varier la sortie.

Les sources modifient la base de départ.

La date change parfois la réalité elle-même.

Et le modèle ajoute sa propre manière de prioriser, nuancer ou simplifier.

Le point sérieux, ce n’est donc pas d’exiger une uniformité artificielle. C’est de comprendre d’où vient l’écart.

En clair : quand deux réponses divergent, la vraie question n’est pas seulement “laquelle choisir ?”, mais “qu’est-ce qui a changé dans le cadre de production ?” C’est là que commence l’analyse utile.