La réponse honnête est simple : parfois, on peut suspecter. Mais prouver avec certitude, c’est beaucoup plus rare.

C’est précisément là que beaucoup de discours deviennent trompeurs. On présente parfois les détecteurs d’IA comme des outils capables de trancher proprement : “écrit par un humain” ou “écrit par une machine”. En réalité, ce niveau de certitude est souvent illusoire.

Un texte peut sembler “trop lisse”, “trop propre”, “trop générique” et pourtant être humain. À l’inverse, un texte fortement aidé par une IA peut paraître naturel, personnel, irrégulier, et passer sous les radars. Le problème n’est donc pas seulement technique. Il est méthodologique : on cherche souvent une preuve là où l’on n’a, au mieux, que des indices.

La bonne approche consiste donc à poser la vraie question : non pas “peut-on toujours détecter un texte d’IA ?”, mais “dans quelles conditions peut-on avoir un soupçon raisonnable, et quelles sont les limites de ce soupçon ?”

Le mythe du détecteur infaillible

L’idée d’un détecteur capable d’identifier de manière fiable l’origine d’un texte est séduisante. Elle rassure. Elle donne l’impression qu’il existe un test simple pour distinguer l’authentique du généré.

Mais cette promesse est fragile.

Pourquoi ? Parce qu’un texte n’embarque pas, par défaut, une étiquette visible indiquant sa provenance. Un détecteur ne “voit” pas une signature magique. Il analyse des probabilités, des régularités, des motifs linguistiques, parfois des structures statistiques. Il essaie de repérer si un texte ressemble à ce qu’un modèle génératif produit souvent.

Cela change tout : un détecteur ne lit pas l’intention, il compare des formes.

Et dès qu’on travaille sur des ressemblances plutôt que sur une preuve directe, on entre dans un terrain instable.

Ce que font réellement les détecteurs

Un détecteur de texte IA ne sait pas “qui” a écrit. Il essaie surtout d’estimer si un texte présente des caractéristiques souvent associées à une génération automatique.

En pratique, il cherche souvent des éléments comme :

- une forte prévisibilité dans les formulations ;

- une structure très régulière ;

- une homogénéité stylistique inhabituelle ;

- peu de ruptures de ton ;

- des transitions propres mais parfois mécaniques ;

- un vocabulaire correct, mais peu incarné ;

- une syntaxe fluide avec peu d’aspérités.

Le problème, c’est qu’aucun de ces indices n’est une preuve.

Un élève très scolaire, un rédacteur prudent, une personne non native qui écrit de façon simple, un professionnel qui suit un cadre rigide, ou un humain qui a beaucoup relu son texte peuvent produire quelque chose de très “détectable” sans avoir utilisé d’IA.

À l’inverse, un texte généré puis fortement retouché, mélangé à des ajouts humains, ou simplement mieux prompté peut devenir beaucoup plus difficile à distinguer.

Pourquoi la certitude est rare

C’est le point central. La certitude est rare parce que les catégories réelles sont beaucoup plus floues qu’on le prétend.

Dans la vraie vie, on n’a pas seulement :

- un texte 100 % humain ;

- un texte 100 % IA.

On a aussi :

- un texte humain corrigé par IA ;

- un texte IA réécrit par un humain ;

- un plan généré par IA puis développé manuellement ;

- un brouillon humain lissé avec une reformulation automatique ;

- un texte hybride où l’outil a servi par endroits seulement ;

- un texte humain influencé par des habitudes d’écriture devenues elles-mêmes plus standardisées.

Autrement dit, la frontière est poreuse.

Un détecteur aime les catégories nettes. L’usage réel, lui, produit des zones grises. C’est exactement pour cela que les verdicts tranchés sont souvent intellectuellement faibles.

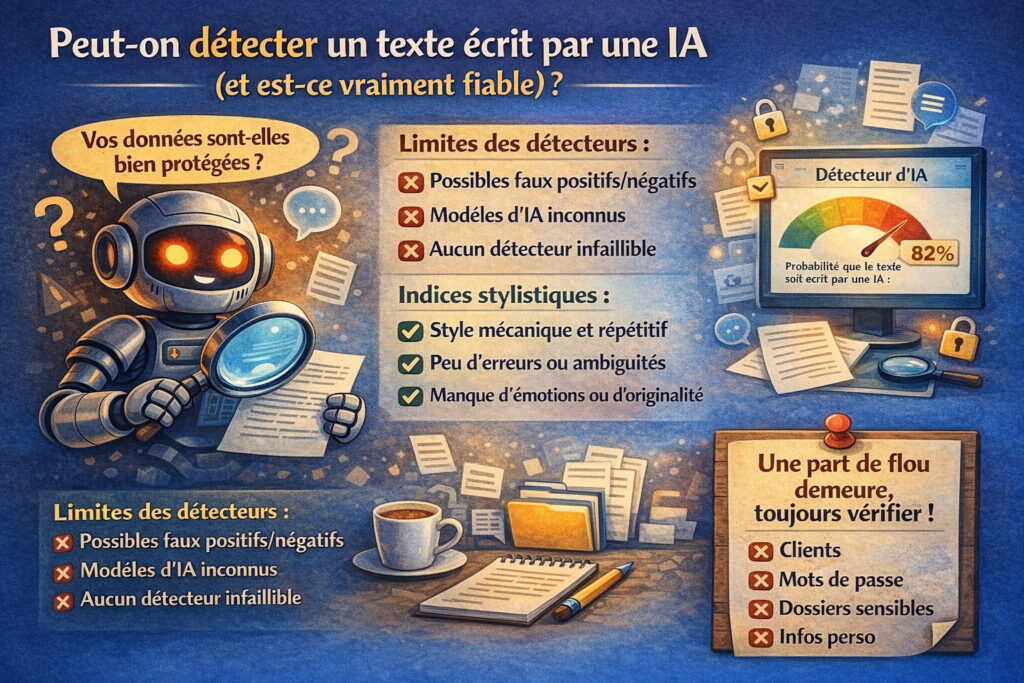

Les limites structurelles des détecteurs

Il faut être froid sur ce point : même les meilleurs détecteurs ont des limites de fond, pas seulement des défauts temporaires.

1. Ils travaillent sur des probabilités, pas sur une preuve d’origine

Un détecteur peut dire qu’un texte “ressemble” à une production d’IA. Cela ne signifie pas qu’il prouve qu’une IA l’a écrit.

Confondre ressemblance statistique et preuve d’auteur est une erreur de raisonnement.

C’est un peu le cœur du problème : on transforme souvent une estimation en accusation.

2. Ils sont sensibles au style plus qu’à la vérité de la provenance

Certains styles humains sont naturellement plus réguliers, plus plats, plus standardisés. Ils peuvent donc être sur-suspectés.

C’est particulièrement vrai pour :

- les textes académiques très normés ;

- les écrits administratifs ;

- les contenus SEO génériques ;

- les résumés scolaires ;

- les textes rédigés par des non-natifs avec un vocabulaire simple ;

- les textes volontairement neutres et structurés.

Le risque ici est évident : on ne détecte pas forcément une machine, on pénalise parfois une écriture disciplinée.

3. Une simple réécriture peut perturber fortement le résultat

Un texte généré par IA peut devenir bien moins détectable après :

- quelques reformulations manuelles ;

- l’ajout d’exemples personnels ;

- des irrégularités volontaires ;

- un changement de rythme ;

- des coupes ;

- des maladresses humaines réintroduites.

Autrement dit, si le texte a été un minimum retravaillé, la fiabilité du détecteur peut chuter fortement.

Cela suffit à ruiner l’idée d’un outil capable de “démasquer” systématiquement.

4. Les textes courts sont particulièrement difficiles à évaluer

Plus un texte est court, moins il y a de matière statistique exploitable.

Sur quelques phrases, un verdict devient encore plus fragile. Le détecteur manque de signal, donc il extrapole davantage.

C’est une faille majeure, parce que beaucoup de gens veulent pourtant juger des mails, des paragraphes, des devoirs courts ou des posts rapides.

5. Les modèles et les styles évoluent

Un détecteur est toujours, d’une certaine manière, en retard sur les usages.

Les modèles génératifs changent. Les prompts s’améliorent. Les humains apprennent à retoucher. Les styles se mélangent. Les outils d’assistance deviennent plus diffus.

Un système entraîné à repérer certains motifs peut donc devenir moins pertinent dès que ces motifs changent ou se banalisent.

Les indices stylistiques qui peuvent faire naître un soupçon

Il existe malgré tout des signaux faibles. Le problème n’est pas de les nier. Le problème, c’est de ne pas les absolutiser.

Certains textes éveillent raisonnablement la suspicion quand ils cumulent plusieurs traits.

1. Une fluidité trop régulière

Le texte est propre de bout en bout, sans rupture de ton, sans aspérité, sans angle mort apparent, avec des transitions toujours impeccables.

Cela peut donner une impression de maîtrise… ou de fabrication trop lisse.

Mais attention : une bonne plume humaine peut aussi écrire proprement. La régularité seule ne suffit pas.

2. Une neutralité excessive

Le texte semble correct, mais il n’a presque aucune densité personnelle, aucune prise de risque, aucune préférence nette, aucune véritable texture.

Il explique, il organise, il équilibre… mais il n’habite pas vraiment ce qu’il dit.

C’est un indice fréquent dans les textes générés : une compétence de surface sans vraie singularité. Mais là encore, certains humains écrivent exactement comme cela, surtout quand ils cherchent à rester prudents.

3. Des formulations génériques qui enchaînent bien sans vraiment marquer

Le texte paraît cohérent, mais on en retient peu. Il enchaîne les idées attendues, les oppositions classiques, les tournures “propres”, sans surprise ni angle fort.

C’est souvent le signe d’un texte optimisé pour sembler bon plutôt que pour dire quelque chose de précis.

Ce n’est pas une preuve d’IA. C’est un indice de standardisation.

4. Une structure très équilibrée, presque trop parfaite

Introduction nette, développement symétrique, arguments bien rangés, conclusion propre : tout est en place, parfois au point de sembler un peu mécanique.

Un texte humain peut évidemment être bien structuré. Mais quand cette perfection formelle s’accompagne d’un fond interchangeable, le soupçon devient plus légitime.

5. Un manque de vécu réel ou d’ancrage concret

Un texte peut parler correctement d’un sujet sans jamais donner :

- de détail incarné ;

- d’exemple précis ;

- de nuance issue de l’expérience ;

- de vrai frottement avec le réel.

Il “sait parler de”, mais semble ne jamais vraiment “avoir traversé” la matière.

C’est un marqueur fréquent des textes générés ou fortement assistés, surtout quand le prompt était large. Mais ce n’est toujours pas une preuve définitive.

Pourquoi ces indices ne suffisent pas

C’est ici qu’il faut rester intellectuellement propre : les indices stylistiques sont utiles pour formuler une hypothèse, pas pour prononcer une condamnation.

Pourquoi ? Parce qu’ils peuvent aussi décrire :

- un texte écrit vite sous contrainte ;

- un texte scolaire très formaté ;

- un texte rédigé par quelqu’un qui imite un style professionnel ;

- un texte relu et lissé plusieurs fois ;

- un auteur peu expérimenté qui suit des structures apprises ;

- un texte volontairement neutre.

En clair : on peut détecter une ressemblance avec certains usages de l’IA, mais on ne remonte pas mécaniquement à une origine certaine.

C’est une distinction essentielle, et beaucoup de gens la sautent.

Le vrai risque : les faux positifs

Le problème le plus grave, ce n’est pas seulement de laisser passer un texte IA. C’est aussi d’accuser à tort un texte humain.

Un faux positif peut avoir des conséquences lourdes :

- soupçon injuste envers un élève ;

- sanction abusive ;

- perte de crédibilité ;

- conflit professionnel ;

- jugement biaisé sur un auteur ;

- confusion entre style “propre” et fraude.

C’est pour cela qu’utiliser un détecteur comme juge final est une mauvaise pratique. Un outil probabiliste ne devrait jamais devenir, à lui seul, une machine à condamner.

Plus l’enjeu est sérieux, plus ce point est important.

Quand le soupçon devient plus solide

S’il n’y a pas de certitude simple, il existe tout de même des cas où l’hypothèse d’un texte généré devient plus robuste.

C’est le cas quand plusieurs éléments se cumulent :

- le détecteur signale un score élevé ;

- le texte présente plusieurs indices stylistiques typiques ;

- l’auteur ne sait pas expliquer certaines formulations qu’il “a écrites” ;

- le niveau du texte ne correspond pas du tout aux productions habituelles ;

- le contenu contient des tournures génériques mais aucune maîtrise réelle dès qu’on creuse ;

- une vérification orale ou une discussion révèle un décalage net entre le texte et la compréhension réelle.

Là, on n’a toujours pas une preuve magique. Mais on a un faisceau d’indices plus sérieux.

La différence est importante : on quitte le fantasme du test unique, et on entre dans une logique d’évaluation croisée.

Ce qui est plus utile qu’un détecteur seul

Si l’objectif est sérieux — pédagogie, recrutement, validation, publication, contrôle qualité — il faut une méthode plus solide qu’un simple score.

Les approches plus intelligentes consistent à croiser plusieurs éléments :

- comparer avec les écrits antérieurs de la personne ;

- regarder l’évolution du style ;

- demander d’expliquer ou de reformuler le contenu ;

- vérifier la compréhension réelle du texte ;

- observer la cohérence entre le niveau affiché et la maîtrise effective ;

- analyser si le texte contient une pensée réelle ou seulement une structure correcte.

Un détecteur peut éventuellement servir d’alerte faible. Il ne devrait pas servir de verdict autonome.

Peut-on rendre un texte IA indétectable ?

Le mot “indétectable” est souvent utilisé n’importe comment. Il faut le traiter avec prudence.

En pratique, un texte généré peut devenir beaucoup plus difficile à soupçonner s’il est :

- réécrit sérieusement ;

- enrichi par de vrais exemples ;

- densifié avec un angle personnel ;

- restructuré de manière moins mécanique ;

- mélangé à une vraie pensée humaine.

Mais cela ne signifie pas qu’il devient “pur” ou totalement impossible à repérer dans tous les contextes. Cela signifie surtout que plus le texte est hybridé, moins la détection brute a de sens.

Et c’est encore une raison pour laquelle la certitude devient rare : à mesure que l’assistance IA se diffuse, le repérage binaire perd en pertinence.

La vraie question : origine du texte ou qualité du texte ?

C’est peut-être le point le plus important.

Dans beaucoup de cas, on pose la mauvaise question. On veut savoir si un texte a été écrit par une IA, alors que la question la plus utile est parfois : ce texte est-il exact, solide, assumé, compris, et honnêtement présenté ?

Un texte 100 % humain peut être vide, faux, paresseux ou trompeur.

Un texte aidé par IA peut être retravaillé, vérifié, enrichi et devenir utile.

Un texte “authentique” n’est pas automatiquement un bon texte.

Un texte “assisté” n’est pas automatiquement un mauvais texte.

Cela ne veut pas dire que l’origine n’a aucune importance. Cela veut dire qu’elle ne devrait pas écraser les autres critères : rigueur, compréhension, responsabilité, transparence.

Ce qu’il faut retenir

Oui, on peut parfois repérer des indices qui font penser à un texte généré par IA. Non, cela ne suffit généralement pas à conclure avec certitude.

Les détecteurs travaillent sur des probabilités, pas sur une preuve directe. Les indices stylistiques peuvent nourrir un soupçon, mais ils restent ambigus. Et plus le texte est hybride, relu, réécrit ou simplement bien maîtrisé, plus la frontière devient floue.

Le vrai danger, ce n’est pas seulement de ne pas détecter un texte d’IA. C’est aussi de croire qu’un score ou une impression stylistique suffit à trancher proprement.

La position sérieuse est donc celle-ci : un détecteur peut signaler, rarement prouver. Un style peut alerter, rarement condamner. Et dès qu’on prétend avoir une certitude automatique, on est souvent déjà en train de simplifier le problème plus qu’on ne le résout.